DeepSeek-Coder-V2

代码生成

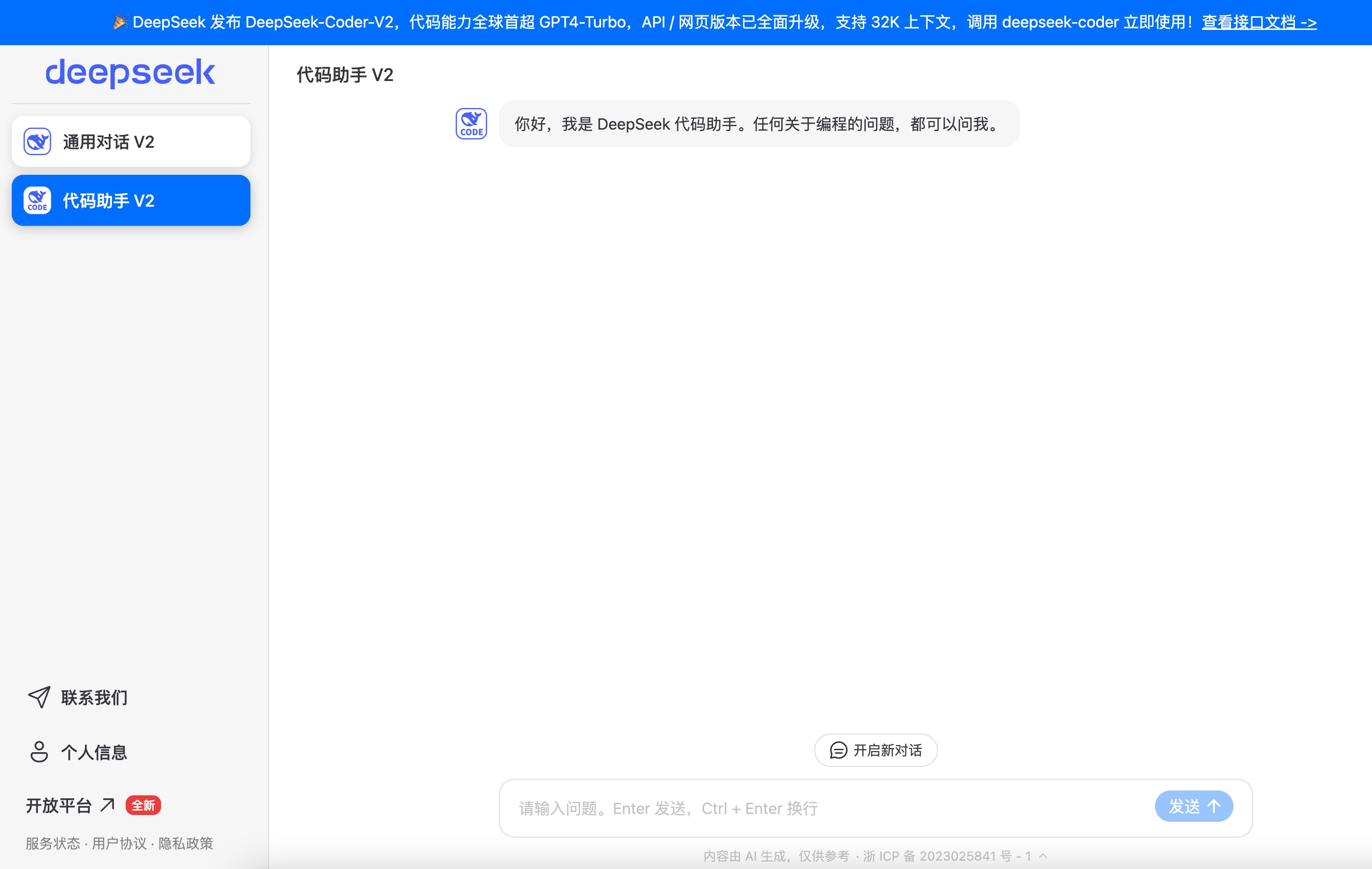

编程辅助

国外精选

DeepSeek-Coder-V2是一个开源的Mixture-of-Experts (MoE) 代码语言模型,性能与GPT4-Turbo相当,在代码特定任务上表现卓越。它在DeepSeek-Coder-V2-Base的基础上,通过6万亿token的高质量多源语料库进一步预训练,显著增强了编码和数学推理能力,同时保持了在通用语言任务上的性能。支持的编程语言从86种扩展到338种,上下文长度从16K扩展到128K。

需求人群:

"DeepSeek-Coder-V2主要面向开发者、编程教育者和代码智能工具开发者。它通过提供高质量的代码生成、补全和修正功能,帮助提升编程效率和教育质量,同时为代码智能工具提供强大的后端支持。"

使用场景示例:

开发者使用DeepSeek-Coder-V2生成特定功能的代码。

编程教育平台集成该模型,提供自动化的编程作业评估。

代码智能工具利用DeepSeek-Coder-V2进行代码补全和错误检测。

浏览量:23

类似应用