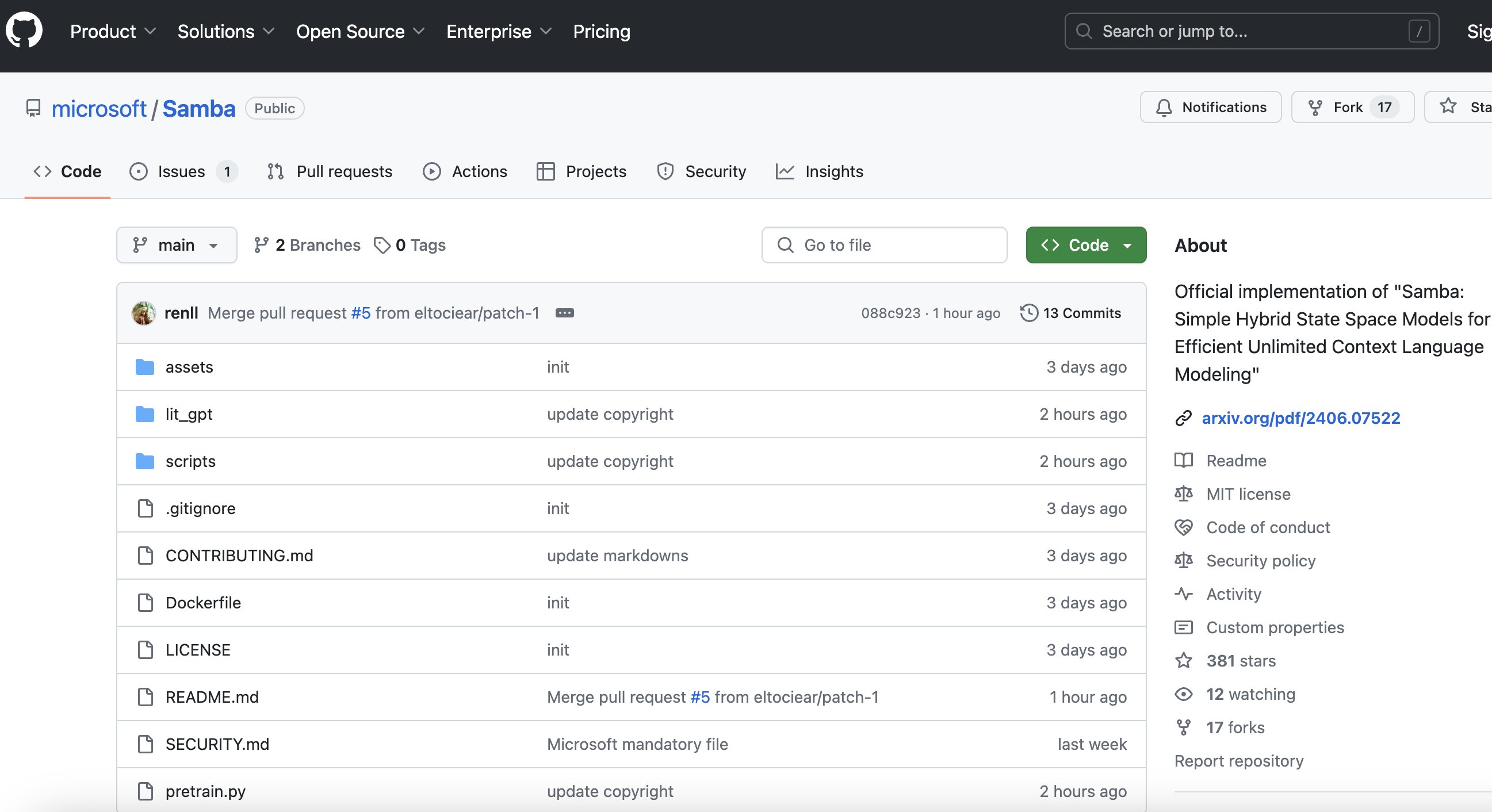

Samba

自然语言处理

机器学习

国外精选

Samba是一个简单而强大的混合模型,具有无限的上下文长度。它的架构非常简单:Samba = Mamba + MLP + 滑动窗口注意力 + 层级MLP堆叠。Samba-3.8B模型在Phi3数据集上训练了3.2万亿个token,主要基准测试(例如MMLU、GSM8K和HumanEval)上的表现大大超过了Phi3-mini。Samba还可以通过最少的指令调整实现完美的长上下文检索能力,同时保持与序列长度的线性复杂度。这使得Samba-3.8B-instruct在下游任务(如长上下文摘要)上表现出色。

需求人群:

"Samba模型主要面向自然语言处理和机器学习领域的研究人员和开发者。它适合需要处理大量文本数据、进行复杂语言模型训练和评估的用户。Samba的长上下文处理能力和高效的计算性能,使其成为研究和开发先进语言模型的理想选择。"

使用场景示例:

研究人员使用Samba模型在长文本摘要任务中取得了突破性进展。

开发者利用Samba进行大规模语言模型的训练和优化,提高了模型性能。

教育机构采用Samba作为教学工具,帮助学生理解复杂的语言模型架构和训练过程。

浏览量:23

类似应用