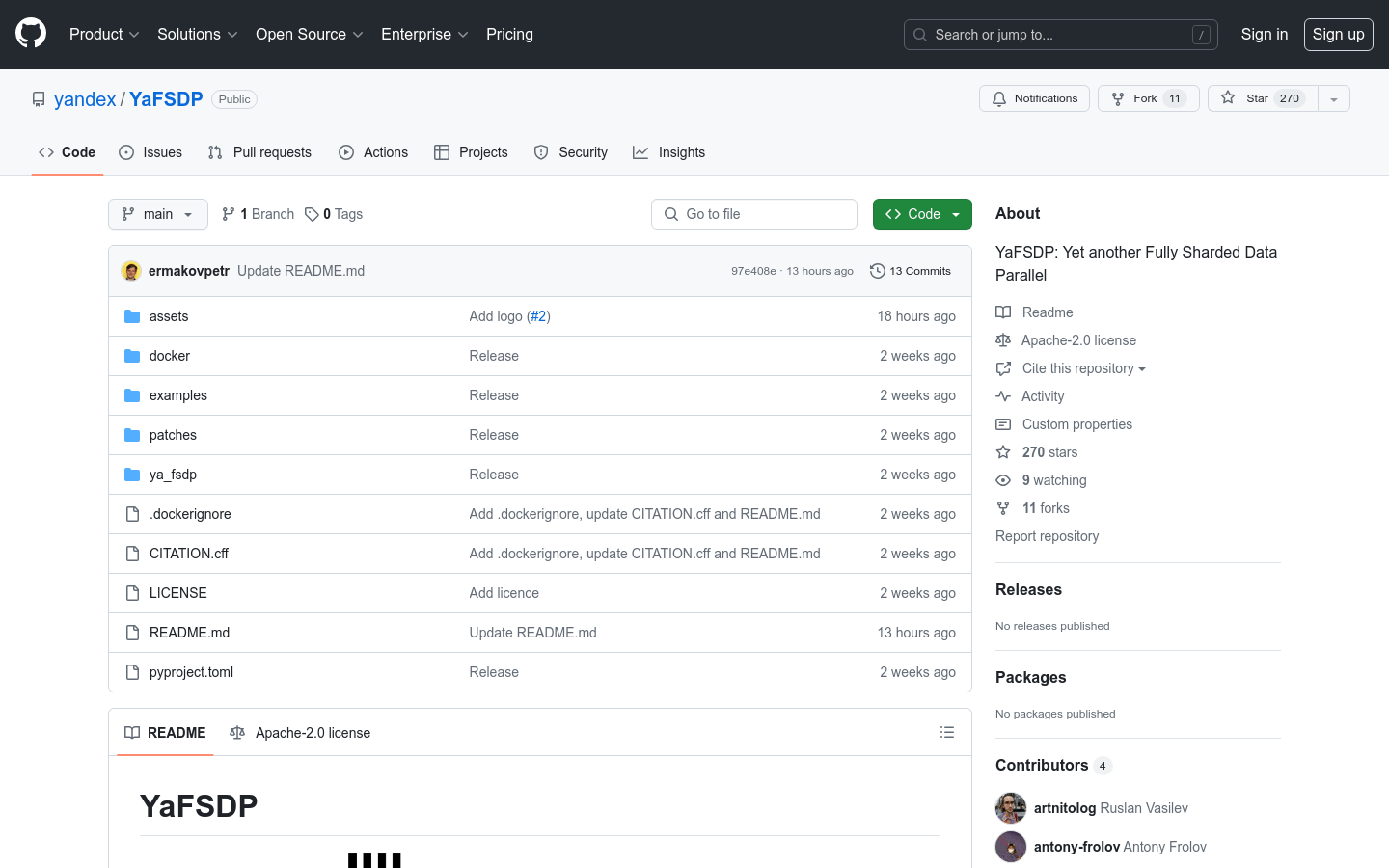

YaFSDP

分布式计算

数据并行

国外精选

YaFSDP是一个分布式数据并行框架,专为与transformer类神经网络结构良好协作而设计。它在预训练大型语言模型(Large Language Models, LLMs)时比传统的FSDP快20%,并且在高内存压力条件下表现更佳。YaFSDP旨在减少通信和内存操作的开销。

需求人群:

"YaFSDP框架适用于需要处理大规模数据和模型的机器学习研究人员和工程师。它特别适合于那些需要在高内存压力环境下进行深度学习模型训练的场景,例如大型语言模型的预训练和微调。"

使用场景示例:

使用YaFSDP进行7B至70B参数规模的语言模型预训练。

在64至256个设备上应用YaFSDP进行模型训练,以提高效率。

利用YaFSDP进行2048至8192个token序列的模型训练。

浏览量:17

类似应用