SuperCLUE

AI评测

模型性能

国内精选

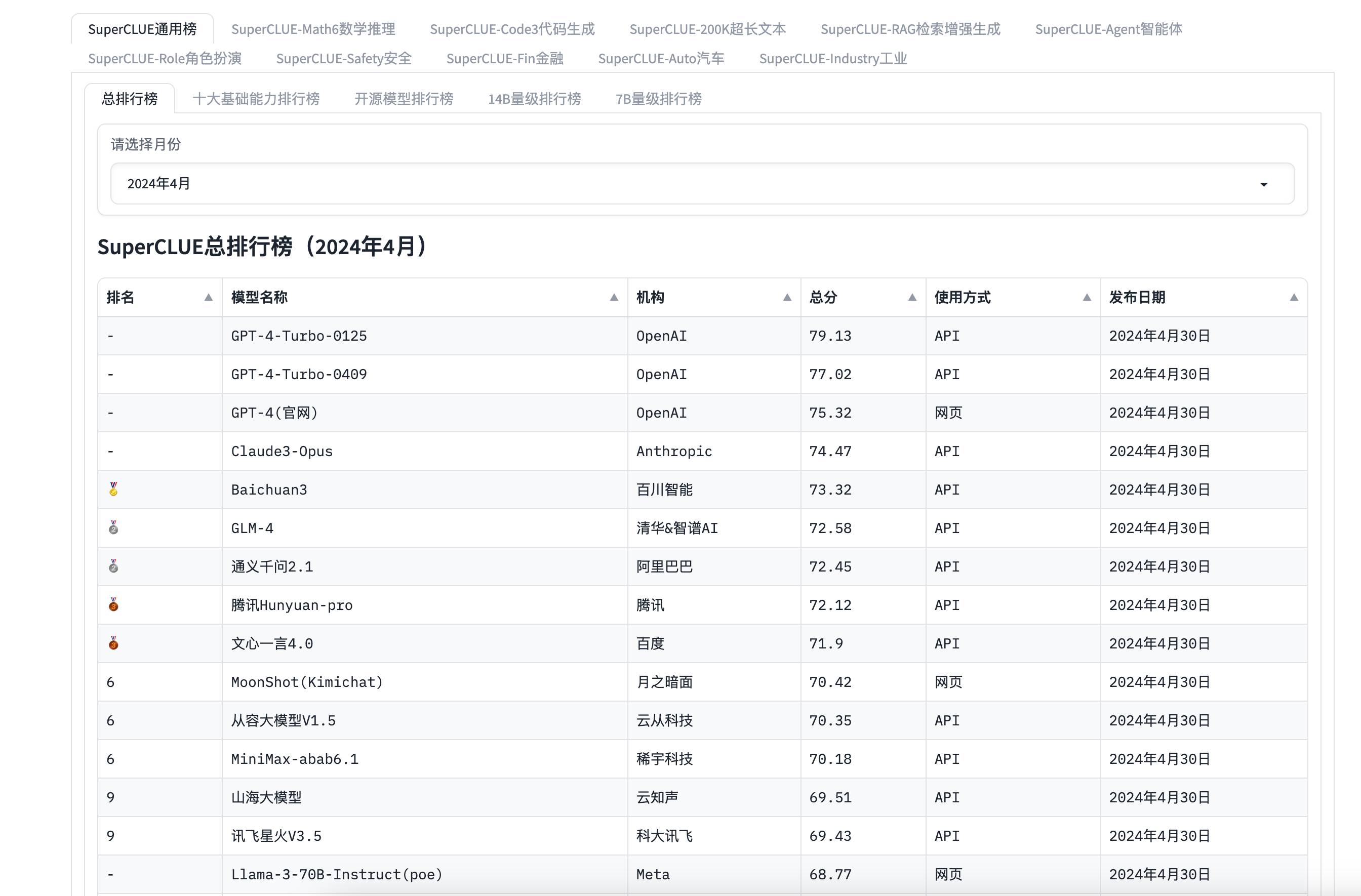

SuperCLUE是一个用于评估和比较大型语言模型性能的在线平台。它提供了多种任务和排行榜,旨在为AI研究者和开发者提供一个标准化的测试环境。SuperCLUE支持各种AI应用场景,包括数学推理、代码生成、超长文本处理等,能够帮助用户准确评估模型在不同任务上的表现和能力。

需求人群:

"SuperCLUE面向AI领域的研究者、开发者以及企业用户,尤其是那些专注于开发和优化大型语言模型的团队。通过SuperCLUE,他们可以有效地测试和验证自己模型的性能,与全球范围内的其他模型进行比较,从而不断提升模型的能力,并在AI领域保持竞争力。"

使用场景示例:

研究者使用SuperCLUE评测其最新开发的AI模型在数学推理任务上的表现。

企业通过SuperCLUE对比不同AI模型在代码生成任务中的性能,以选择最适合的模型集成到产品中。

AI开发者利用SuperCLUE的API接口,实现模型性能的自动化测试和监控。

浏览量:6

类似应用