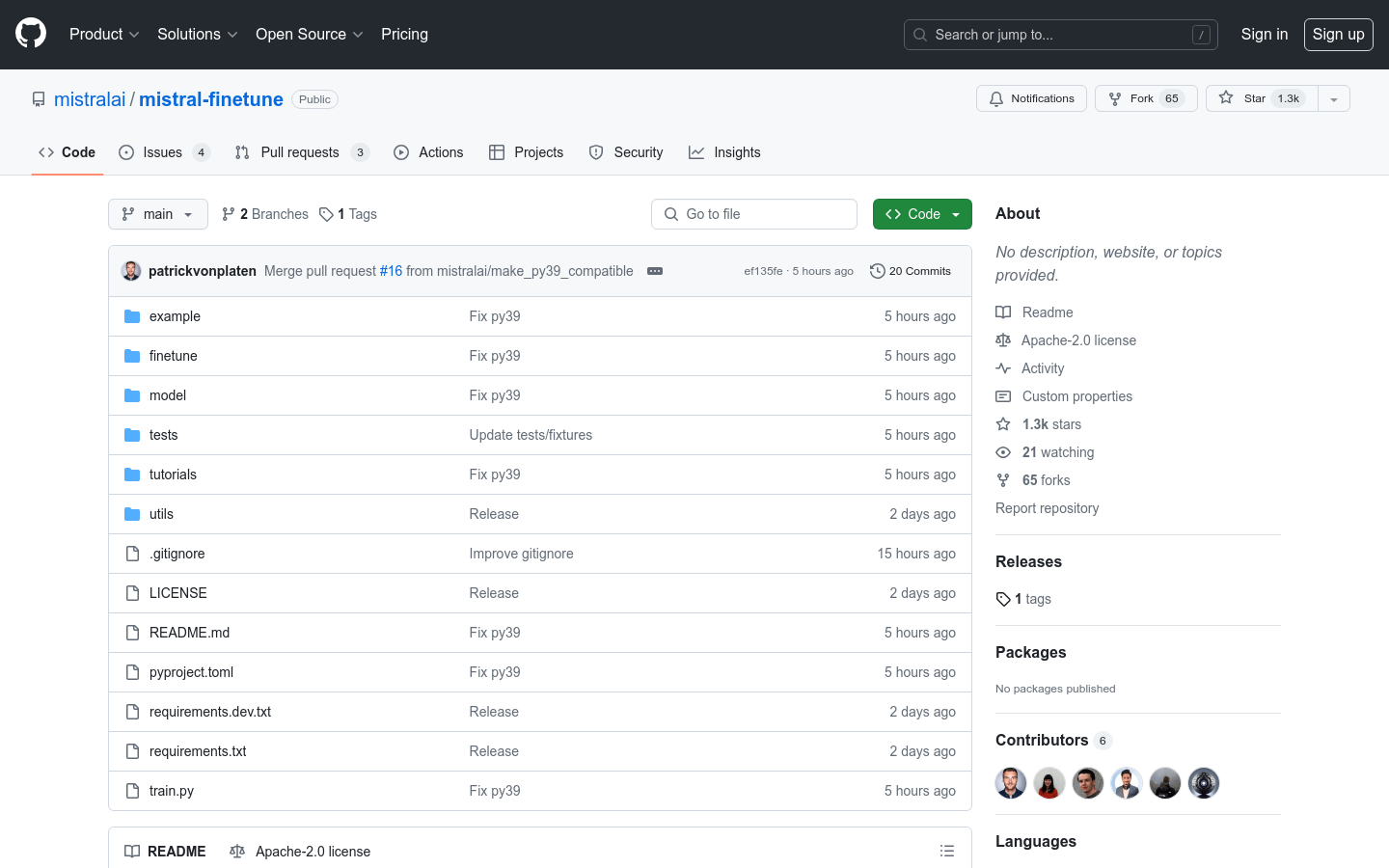

mistral-finetune

微调

LoRA

国外精选

mistral-finetune是一个轻量级的代码库,它基于LoRA训练范式,允许在冻结大部分权重的情况下,只训练1-2%的额外权重,以低秩矩阵微扰的形式进行微调。它被优化用于多GPU单节点训练设置,对于较小模型,例如7B模型,单个GPU就足够了。该代码库旨在提供简单、有指导意义的微调入口,特别是在数据格式化方面,并不旨在涵盖多种模型架构或硬件类型。

需求人群:

"目标受众为需要对大型语言模型进行微调的研究人员和开发人员。该产品适合他们,因为它提供了一个轻量级、高效的微调解决方案,尤其适用于资源有限或需要特定功能定制的场景。"

使用场景示例:

研究人员使用mistral-finetune微调7B模型,以适应特定的对话系统。

开发人员利用该库为聊天机器人添加新功能,通过微调模型来理解用户查询。

教育机构使用mistral-finetune对学生提交的论文进行自动评分,提高评分效率。

浏览量:9

类似应用