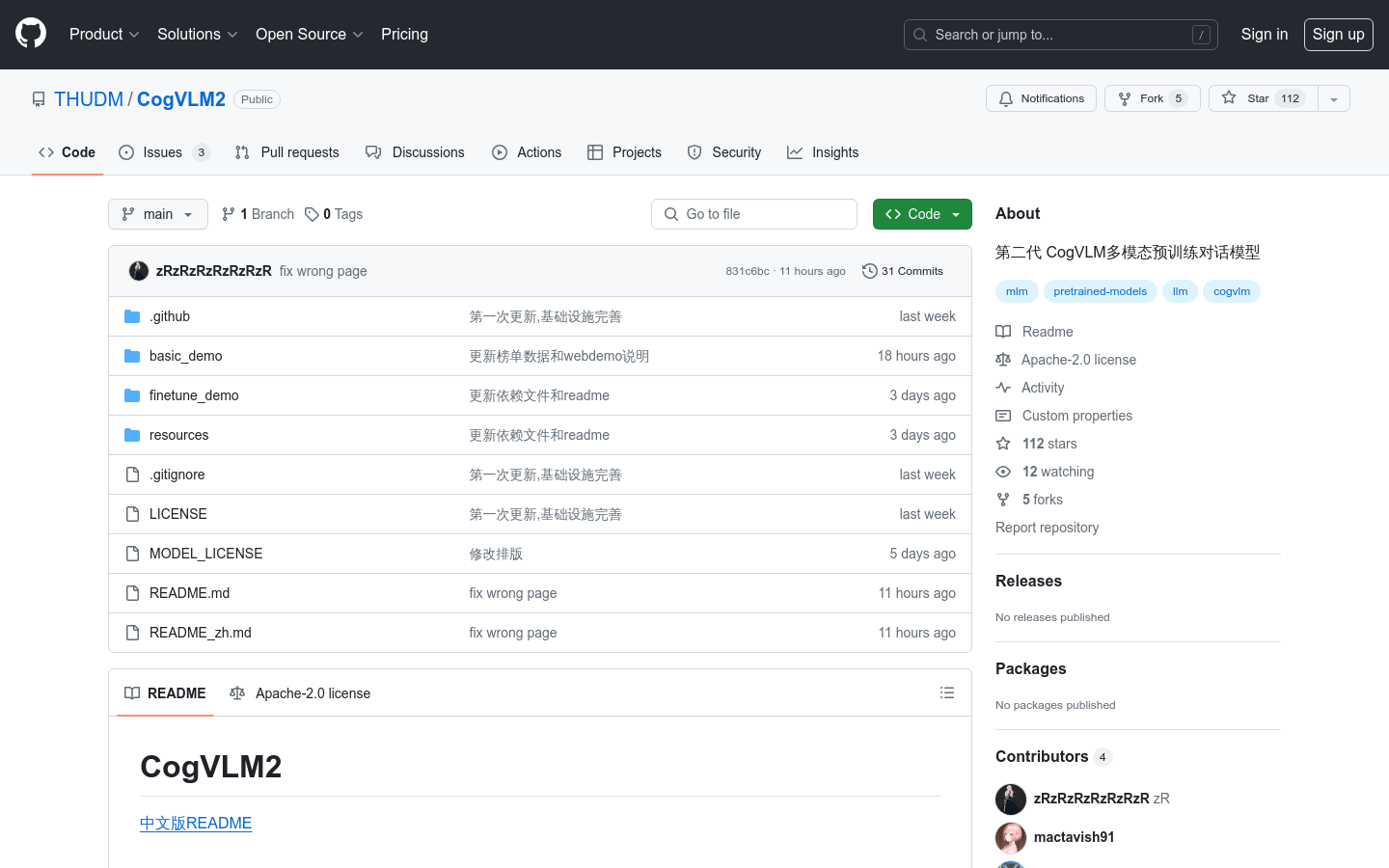

CogVLM2

多模态

预训练模型

国内精选

CogVLM2是由清华大学团队开发的第二代多模态预训练对话模型,它在多个基准测试中取得了显著的改进,支持8K内容长度和1344*1344的图像分辨率。CogVLM2系列模型提供了支持中文和英文的开源版本,能够与一些非开源模型相媲美的性能。

需求人群:

"CogVLM2适合需要进行多模态对话和图像理解的研究者和开发者,特别是那些在中文和英文环境下工作,需要处理长文本和高分辨率图像的专业人士。"

使用场景示例:

用于开发智能客服系统,提高客户服务效率

在教育领域,辅助教学,提供图像和文本的交互式学习体验

在医疗领域,辅助医生进行病例分析和图像识别

浏览量:9

类似应用