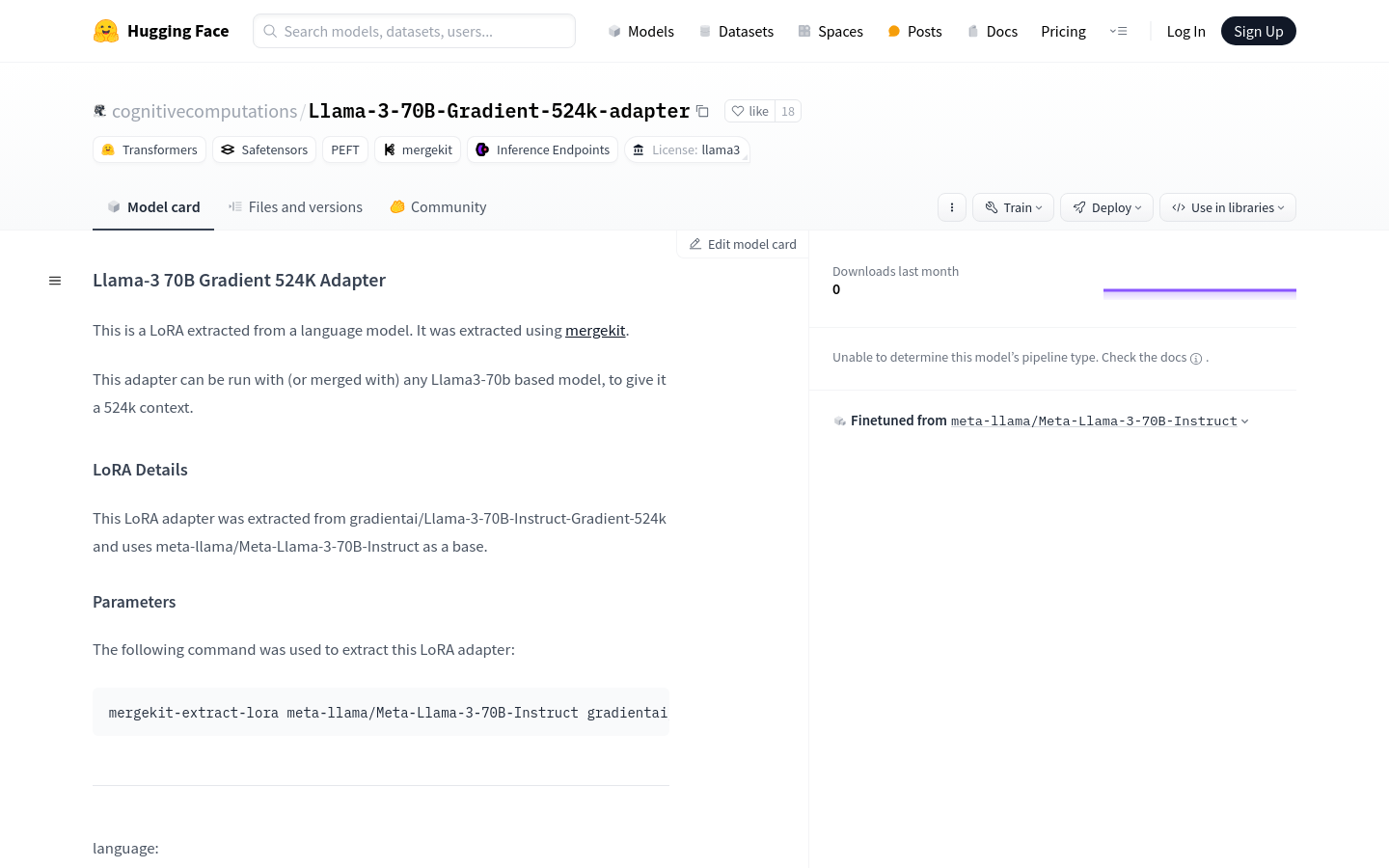

Llama-3 70B Gradient 524K Adapter

LoRA

Transformers

国外精选

Llama-3 70B Gradient 524K Adapter是一个基于Llama-3 70B模型的适配器,由Gradient AI Team开发,旨在通过LoRA技术扩展模型的上下文长度至524K,从而提升模型在处理长文本数据时的性能。该模型使用了先进的训练技术,包括NTK-aware插值和RingAttention库,以高效地在高性能计算集群上进行训练。

需求人群:

适用于需要处理大量文本数据的开发者和企业

适合构建定制AI模型或代理,以支持关键业务操作

适用于需要长文本理解和生成的应用场景

对于需要优化模型安全性和有用性的开发者而言,是一个理想的选择

使用场景示例:

用于开发能够理解长篇文章的自动助理

在商业智能中分析和预测市场趋势

作为聊天机器人的后端,提供更丰富的对话内容

浏览量:0

类似应用